dify通过ollama连接deepseek

简介

首先我们得明白一下概念,dify、ollama、deepseek都是什么?

dify:一个平台,一个简单易用开源的LLMOps(Language Model Operations)平台,我们可以在上面可视化的开发编排AI应用。

ollama:一个开源的大模型服务工具,帮助用户快速在本地运行大模型。

deepseek:国产的大模型。

所以我们要在dify编排大模型应用,就需要有一个大模型,而ollama刚好可以帮我部署运行大模型。所以ollama在这里更像是dify平台和deepseek大模型之间的连接工具。

ollama安装

可以在ollama官网直接下载安装https://ollama.com/。

linux安装命令:curl -fsSL https://ollama.com/install.sh | sh

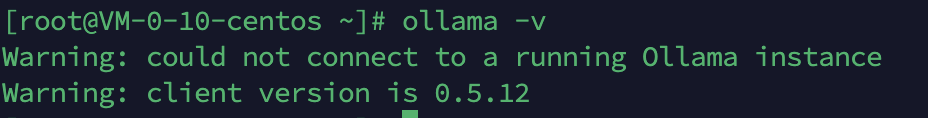

安装之后可以通过 ollama -v 命令查看是否安装好。

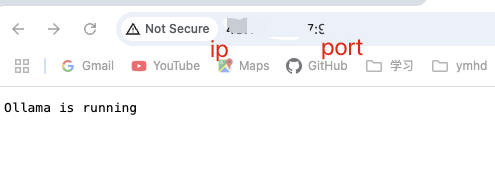

ollama的默认端口是11434,安装完可以通过浏览器打开ip和port界面,可以看到界面提示 ollama is running

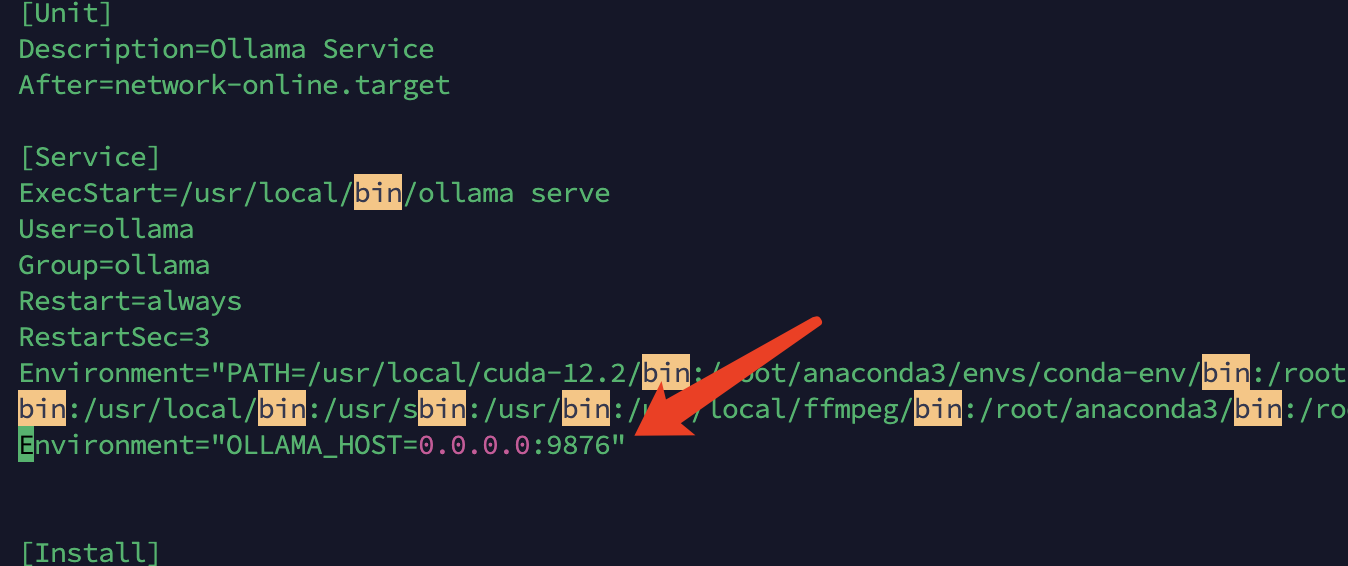

有默认端口,就可以改端口,可以通过修改启动文件,从而制定端口

vim /etc/systemd/system/ollama.service

可以看到这里我指定了9876端口

deepseek安装

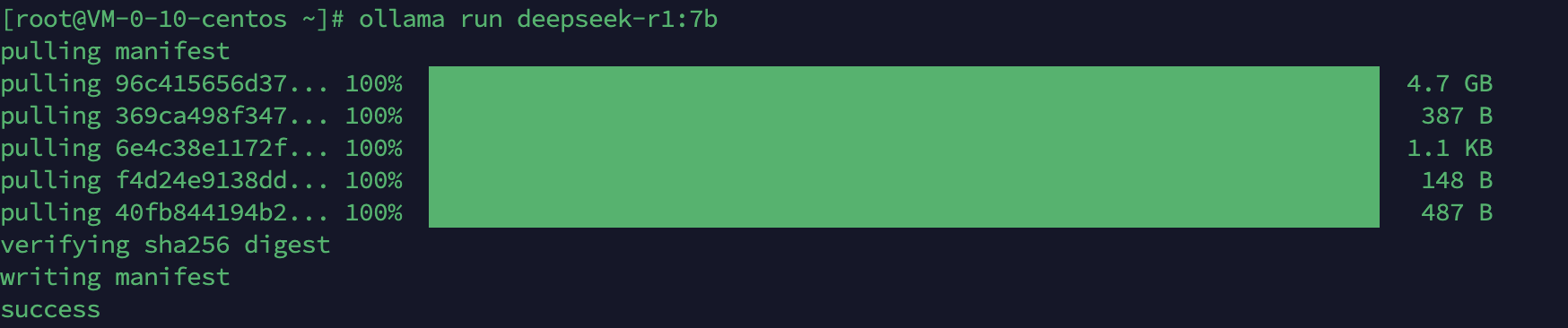

直接运行ollama run deepseek-r1:7b命令按转,当然也可以安装其他版本或者其他厂商的大模型。

dify安装

这里我是通过docker安装的,docker的安装过程就详细展示,可自行搜索教程安装docker。

dify的安装命令:

1 | git clone https://github.com/langgenius/dify.git |

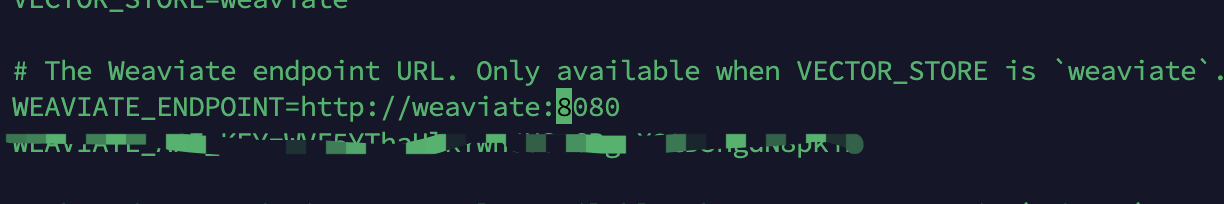

其中dify默认的端口是80,我们要想修改端口的话,可以在 .env 环境配置中修改端口号。可以看到,这里我改成了8080。改完重启dify

dify连接deepseek

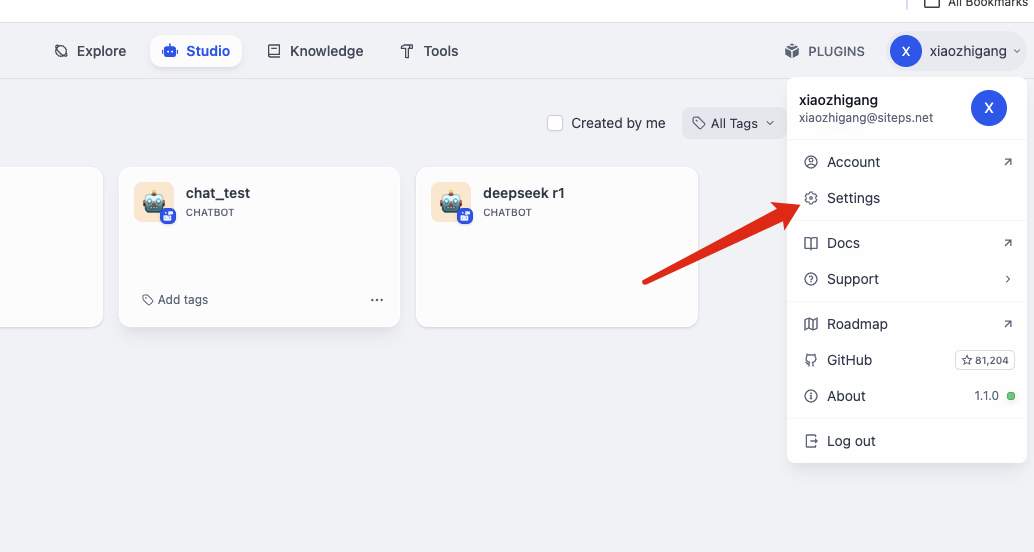

通过浏览器打开 http://ip:port 界面 ip为自己主机ip,port为上面自己设置的port。在一系列账号密码注册之后到主页面。在主页面的个人账号下设置里配置大模型。

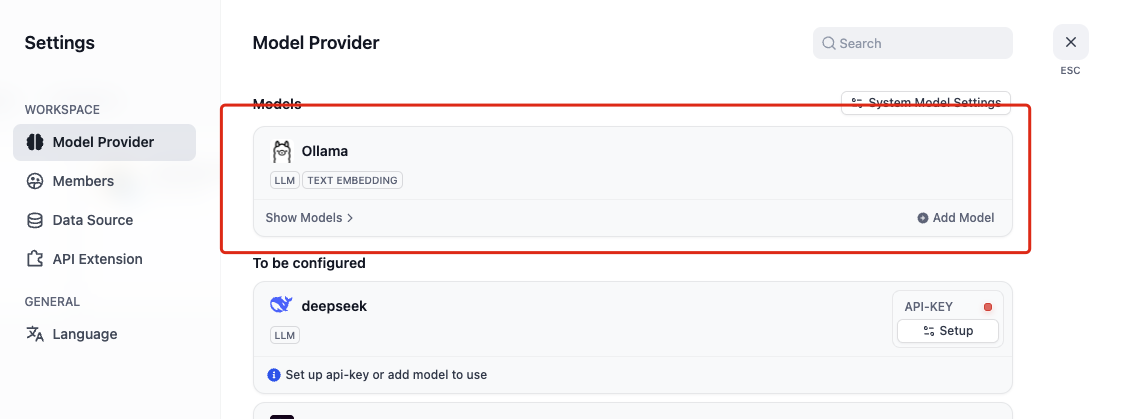

在setting里面,找到模型厂商(Model Provider),在下面的 to be configured 的配置中找到ollama的配置,安装好插件配置,成功安装后如图。

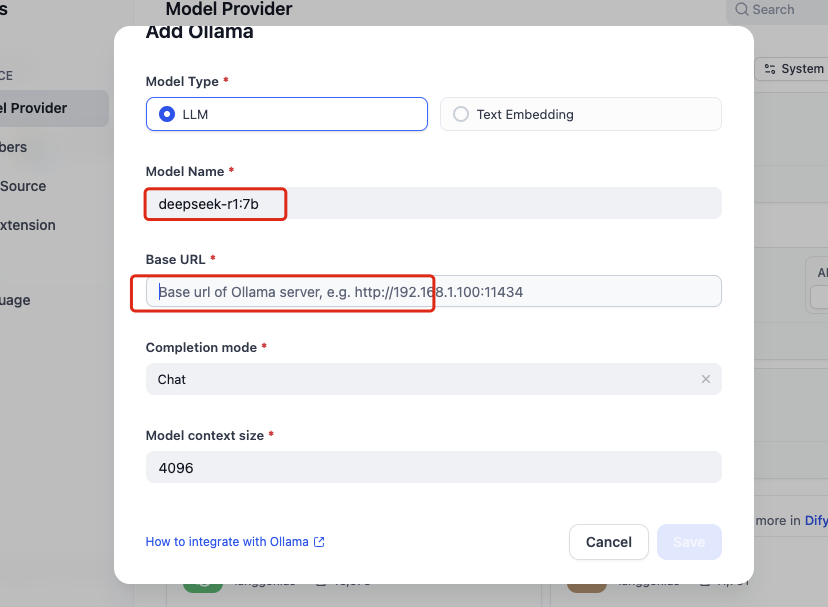

在右下角中的Add model中添加模型。

model name:一定要注意,写的是具体部署的模型型号,我们部署的deepseek-r1:7b,那这里也要填写deepseek-r1:7b,开始我以为可以随意命名,结果搞了半天都没连接上。

base url:填写上面ollama可以在浏览器打开的地址。

连接完就可以使用了,后面再分享怎么构建知识库怎么使用。